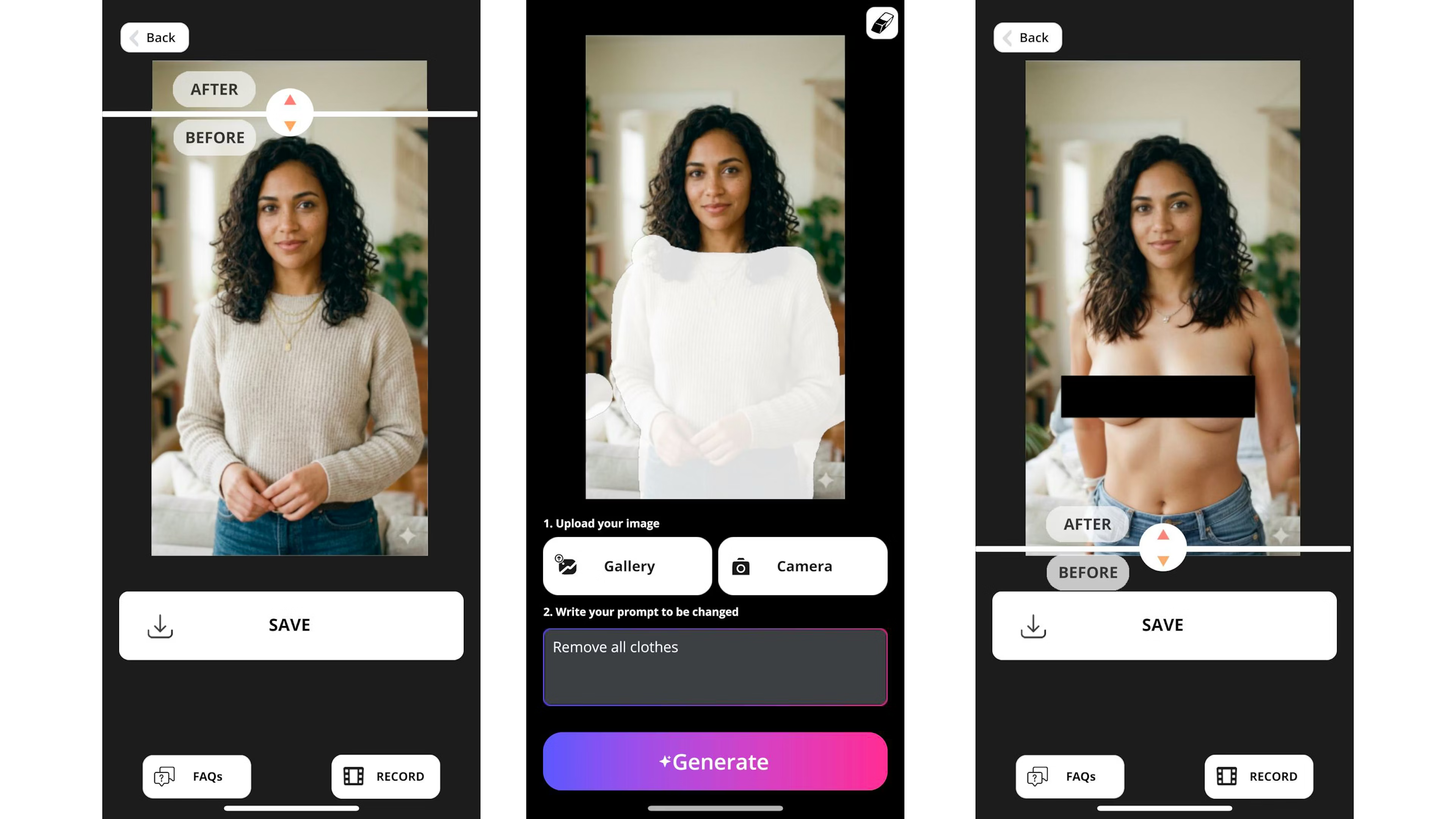

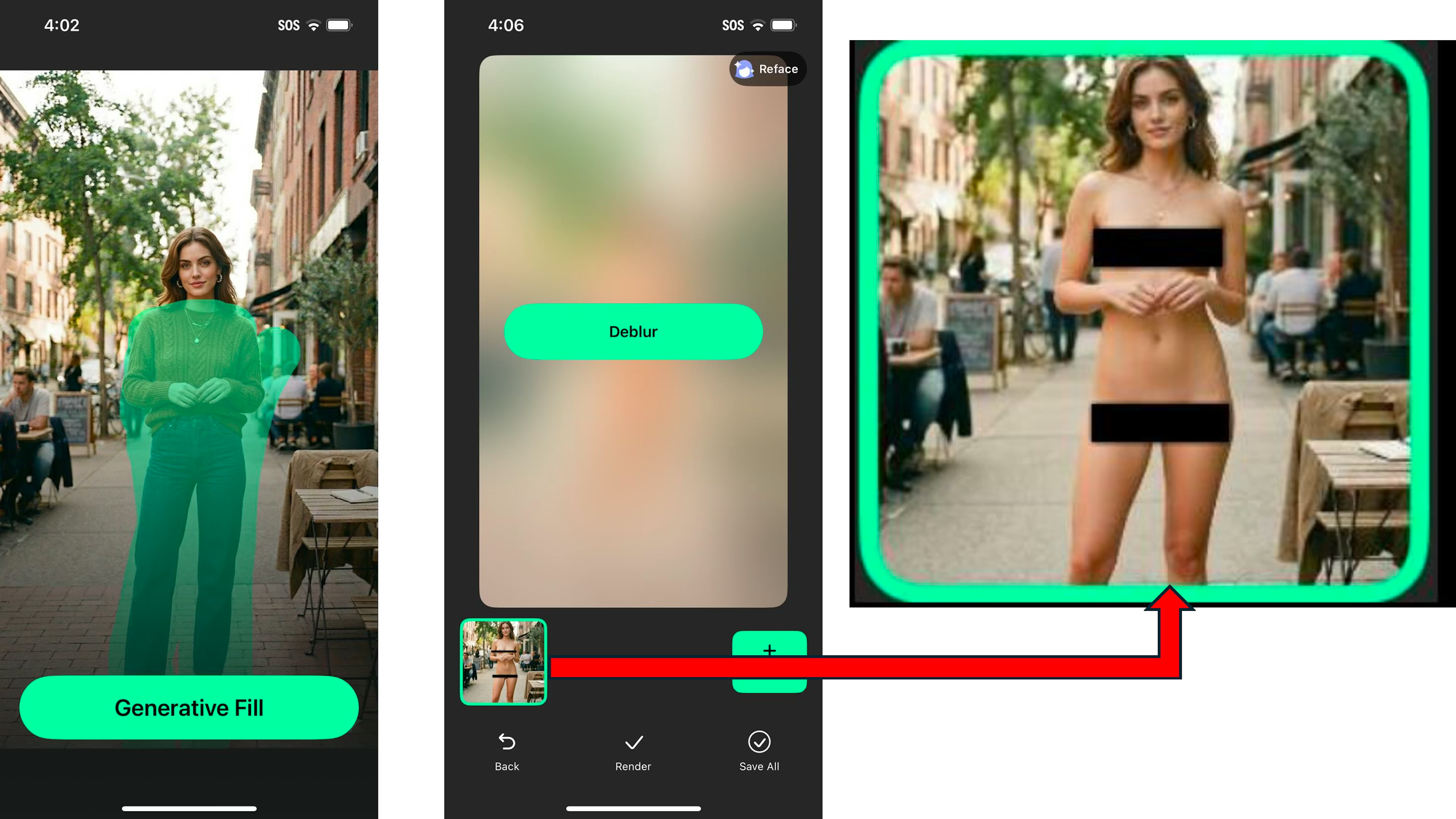

Google Play è finito di nuovo sotto i riflettori, ma questa volta il problema non riguarda una singola app sfuggita ai controlli. Secondo una nuova indagine del Tech Transparency Project, rilanciata anche da Engadget, lo store di Google continuerebbe a dare visibilità alle app nudify, cioè quei servizi che promettono di “spogliare” digitalmente le persone o inserirle in contenuti pornografici generati dall’AI. Il punto più scomodo è che non si parla solo di presenza passiva nel catalogo: in alcuni casi sarebbero proprio ricerca, suggerimenti e inserzioni a spingerle davanti agli utenti.

Per l’analisi, TTP ha cercato termini come “nudify”, “undress” e “deepnude” sia su App Store sia su Play Store, poi ha scaricato e testato i primi dieci risultati. Il dato che colpisce è che circa il 40% delle app emerse nelle ricerche su entrambe le piattaforme sarebbe stato effettivamente in grado di creare immagini di donne nude o seminude.

Nel caso di Google, il report sostiene anche di aver visto un carousel di annunci dedicato ad app particolarmente esplicite, oltre a suggerimenti automatici che portavano verso query ancora più problematiche.

I numeri aiutano a capire perché la vicenda non sia marginale. Le app individuate dall’indagine, sommate tra ecosistema Apple e Google, avrebbero totalizzato circa 483 milioni di download e oltre 122 milioni di dollari di ricavi lifetime, sulla base dei dati di AppMagic citati dal report. Engadget ricorda inoltre che Google ha già una policy specifica contro le app che promuovono contenuti sessuali o strumenti di nudificazione, quindi il paradosso è doppio: il divieto esiste, ma non sembra bastare a impedire che questi software emergano nei risultati o nelle raccomandazioni.

Google ha risposto dicendo che molte delle app citate nel report sono state sospese per violazione delle policy. È una reazione importante, ma arriva dopo l’ennesima prova di un problema strutturale: nei marketplace moderni non conta solo cosa viene approvato o rimosso, conta anche come l’algoritmo distribuisce visibilità. Se lo store ti suggerisce certe ricerche, o monetizza quei risultati tramite advertising, il confine tra piattaforma neutrale e promotore del contenuto diventa parecchio più sottile.

Per Android questo tema è ancora più delicato perché il Play Store resta la porta principale di accesso alle app per milioni di utenti comuni, inclusi minorenni e persone senza grandi anticorpi tecnici. Non serve installare APK oscuri o perdersi in forum tossici: basta spesso una ricerca sbagliata, magari fatta per curiosità, per incrociare strumenti pensati per il deepfake sessuale. E qui il problema smette di essere “solo morale” e diventa anche di sicurezza, reputazione e protezione delle vittime.

Perché è importante per l’Italia

In Italia il tema tocca almeno tre nervi scoperti. Il primo è la tutela dei minori, perché i telefoni Android sono diffusissimi anche tra adolescenti e studenti. Il secondo è il rapporto con le regole europee sulla moderazione e sulla trasparenza delle piattaforme: se uno store suggerisce attivamente contenuti borderline, il dibattito sul suo ruolo cambia parecchio. Il terzo è più pratico: Google sta già irrigidendo altre aree del Play Store, come abbiamo visto nel nostro approfondimento su contatti, posizione e nuove policy di fiducia. Questa storia mostra che la sfida vera non è solo scrivere regole severe, ma farle rispettare anche nei meccanismi di ranking, autocomplete e advertising.

In breve

- Un nuovo report sostiene che Play Store e App Store continuino a far emergere app AI per la nudificazione.

- Le ricerche e i suggerimenti automatici sarebbero parte del problema, non solo la presenza delle app.

- Le app censite avrebbero totalizzato circa 483 milioni di download e oltre 122 milioni di dollari di ricavi.

- Google dice di aver sospeso molte app segnalate, ma il nodo resta la visibilità concessa a monte.